工具调用

概览

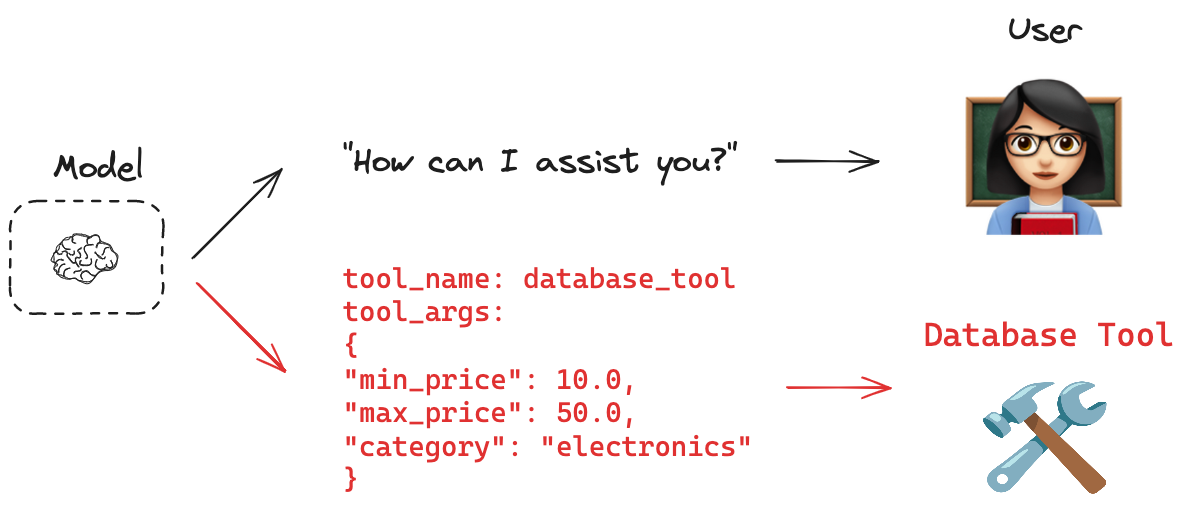

许多AI应用程序会直接与人类交互。在这种情况下,模型以自然语言响应是合适的。 但如果我们希望模型也能直接与系统(如数据库或API)进行交互呢? 这些系统通常具有特定的输入模式;例如,API经常需要特定的负载结构。 这促使了“工具调用”概念的产生。你可以使用工具调用来请求符合特定模式的模型响应。

你有时会听到术语 function calling。我们经常将此术语与 tool calling 互换使用。

核心概念

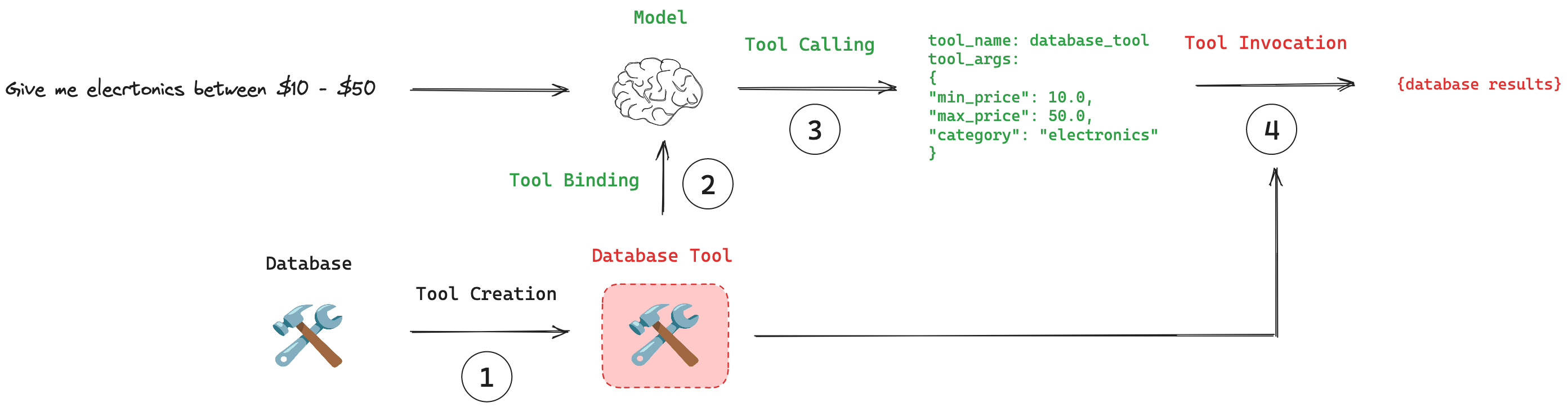

(1) 工具创建: 使用 @tool 装饰器创建一个 工具。工具是函数与其模式之间的关联。 (2) 工具绑定: 该工具需要连接到支持工具调用的模型。这使模型能够意识到该工具及其所需的输入模式。 (3) 工具调用: 在适当的情况下,模型可以决定调用工具,并确保其响应符合工具的输入模式。 (4) 工具执行: 可以使用模型提供的参数来执行该工具。

推荐用法

此伪代码展示了使用工具调用的推荐工作流程。

创建的工具作为列表传递给 .bind_tools() 方法。

该模型可以像平常一样被调用。如果进行了工具调用,模型的响应将包含工具调用参数。

这些工具调用参数可直接传递给工具。

# Tool creation

tools = [my_tool]

# Tool binding

model_with_tools = model.bind_tools(tools)

# Tool calling

response = model_with_tools.invoke(user_input)

工具创建

创建工具的推荐方法是使用 @tool 装饰器。

from langchain_core.tools import tool

@tool

def multiply(a: int, b: int) -> int:

"""Multiply a and b."""

return a * b

工具绑定

查看我们的 模型集成页面,了解支持工具调用的服务提供商列表。

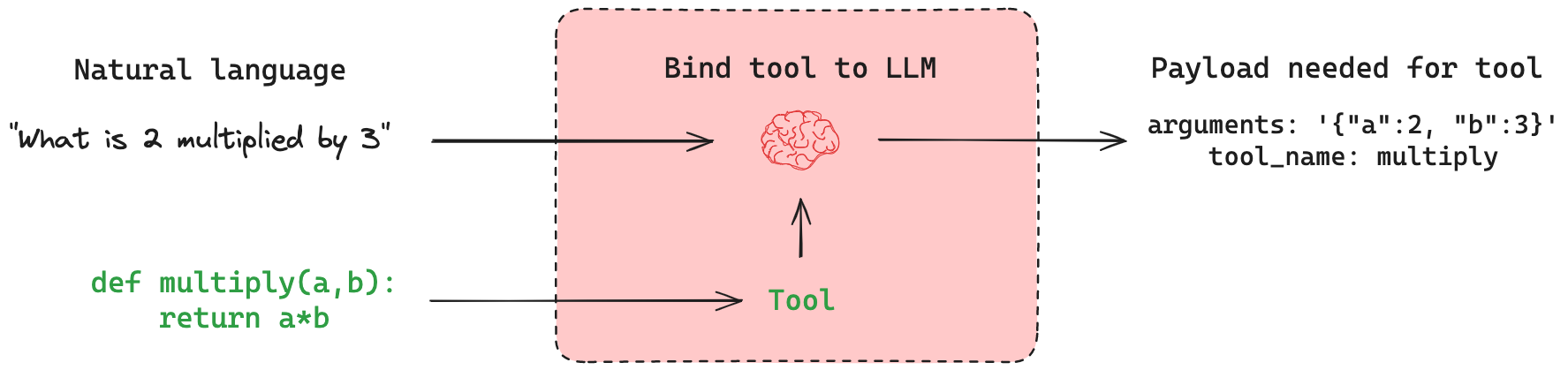

理解的核心概念是,LangChain为将工具连接到模型提供了一个标准化的接口。

.bind_tools() 方法可用于指定模型可以调用哪些工具。

model_with_tools = model.bind_tools(tools_list)

作为一个具体示例,让我们取一个函数 multiply 并将其绑定为一个支持工具调用的模型的工具。

def multiply(a: int, b: int) -> int:

"""Multiply a and b.

Args:

a: first int

b: second int

"""

return a * b

llm_with_tools = tool_calling_model.bind_tools([multiply])

工具调用

工具调用的一个关键原则是,模型根据输入的相关性来决定何时使用工具。模型并不总是需要调用工具。 例如,对于一个不相关的输入,模型就不会调用工具:

result = llm_with_tools.invoke("Hello world!")

结果将是一个 AIMessage,其中包含模型以自然语言形式返回的响应(例如,“你好!”)。

然而,如果我们传递一个与工具相关的输入,模型应该选择调用该工具:

result = llm_with_tools.invoke("What is 2 multiplied by 3?")

和之前一样,输出 result 将是一个 AIMessage。

但是,如果调用了工具,result 将具有一个 tool_calls 属性。

此属性包含执行工具所需的所有内容,包括工具名称和输入参数:

result.tool_calls

{'name': 'multiply', 'args': {'a': 2, 'b': 3}, 'id': 'xxx', 'type': 'tool_call'}

有关使用的更多详细信息,请参阅我们的 操操作指南!

工具执行

工具 实现了 可运行 接口,这意味着它们可以直接被调用(例如,tool.invoke(args))。

LangGraph 提供预构建的组件(例如 ToolNode),这些组件通常会代表用户调用工具。

- 查看我们关于工具调用的操操作指南。

- 查看 LangGraph 文档中关于使用 ToolNode 的说明。

最佳实践

在设计供模型使用的工具时,重要的是要记住:

- 具有明确 工具调用API 的模型在工具调用方面将比未经微调的模型表现更好。

- 如果工具的名称和描述选择得当,模型的表现将会更好。

- 简单且功能单一的工具比复杂的工具更容易被模型使用。

- 要求模型从大量工具列表中进行选择,会给模型带来挑战。