如何通过重复进行评估

运行多次重复可以更准确地评估系统的性能,因为大语言模型的输出不是确定性的。输出结果在每次重复之间可能有所不同。对于容易出现高变异性的系统(例如智能体),重复是一种减少噪声的方法。

在实验中配置重复次数

向 num_repetitions / evaluate 函数添加可选的 aevaluate 参数(Python,TypeScript),以指定在数据集的每个示例上执行评估的次数。例如,如果数据集中有 5 个示例,并将该参数设置为 num_repetitions=5,则每个示例将运行 5 次,总共运行 25 次。

- Python

- TypeScript

from langsmith import evaluate

results = evaluate(

lambda inputs: label_text(inputs["text"]),

data=dataset_name,

evaluators=[correct_label],

experiment_prefix="Toxic Queries",

num_repetitions=3,

)

import { evaluate } from "langsmith/evaluation";

await evaluate((inputs) => labelText(inputs["input"]), {

data: datasetName,

evaluators: [correctLabel],

experimentPrefix: "Toxic Queries",

numRepetitions=3,

});

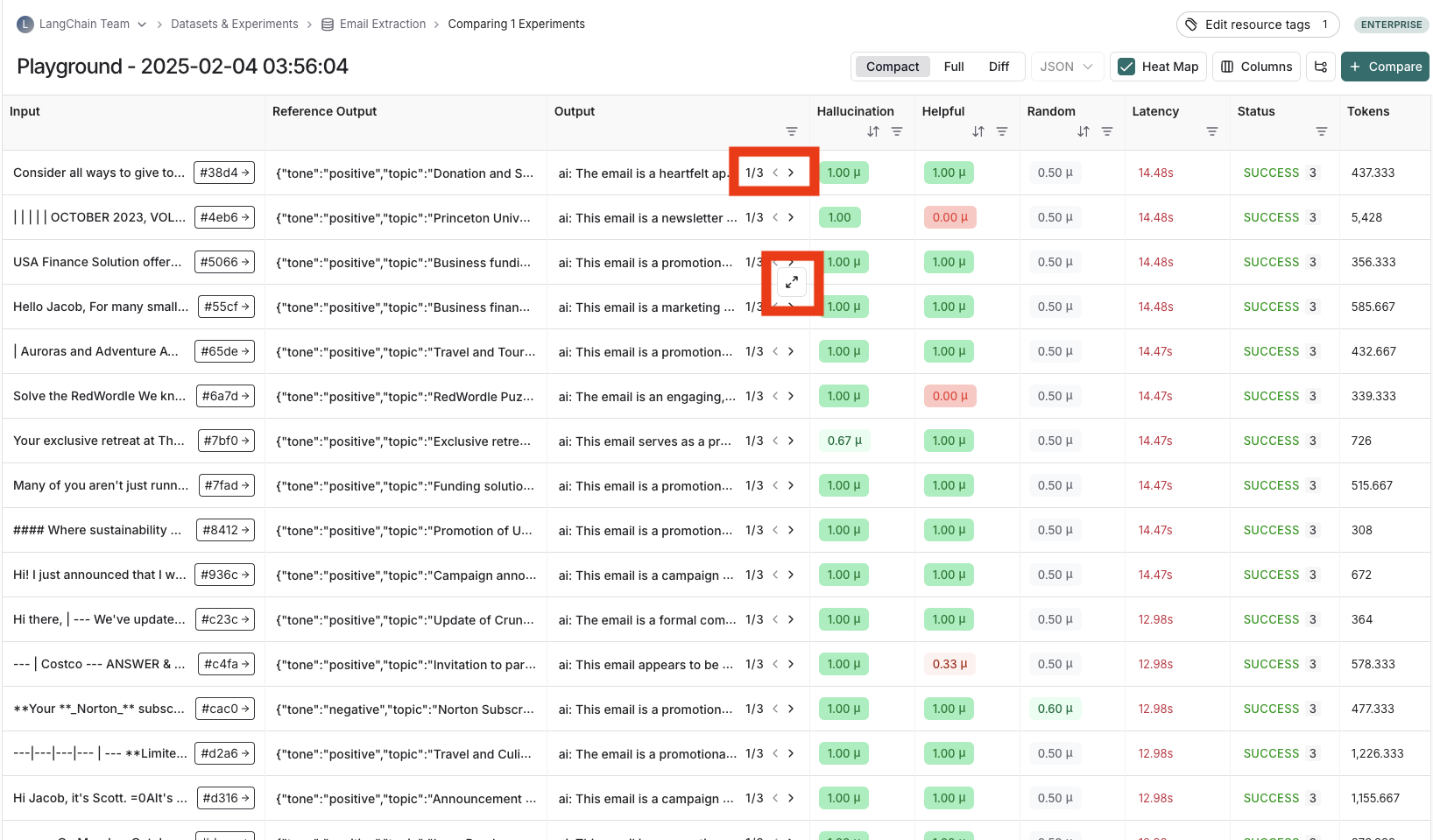

查看带有重复次数的实验运行结果

如果使用重复次数运行了实验,输出结果列中将出现箭头,以便您可以在表格中查看输出。要查看每次重复运行的结果,请将鼠标悬停在输出单元格上并点击展开视图。 当您使用重复次数运行实验时,LangSmith 会在表格中显示每个反馈分数的平均值。单击反馈分数可查看单次运行的反馈分数,或查看重复次数之间的标准差。